Chinese, Simplified

SEO Title

人工智能风险管理框架(AI RMF)旨在自愿使用,并提高将可信度(trustworthiness )考虑纳入人工智能产品、服务和系统的设计、开发、使用和评估的能力。

作为一种共识资源,人工智能RMF是在18个月的时间里以公开、透明、多学科和多利益相关者的方式开发的,并与来自私营企业、学术界、民间社会和政府的240多个贡献组织合作。在人工智能RMF开发过程中收到的反馈可在NIST网站上公开获取。

框架风险

框架风险包括以下信息:

- 了解和应对风险、影响和危害

- 人工智能风险管理面临的挑战

观众

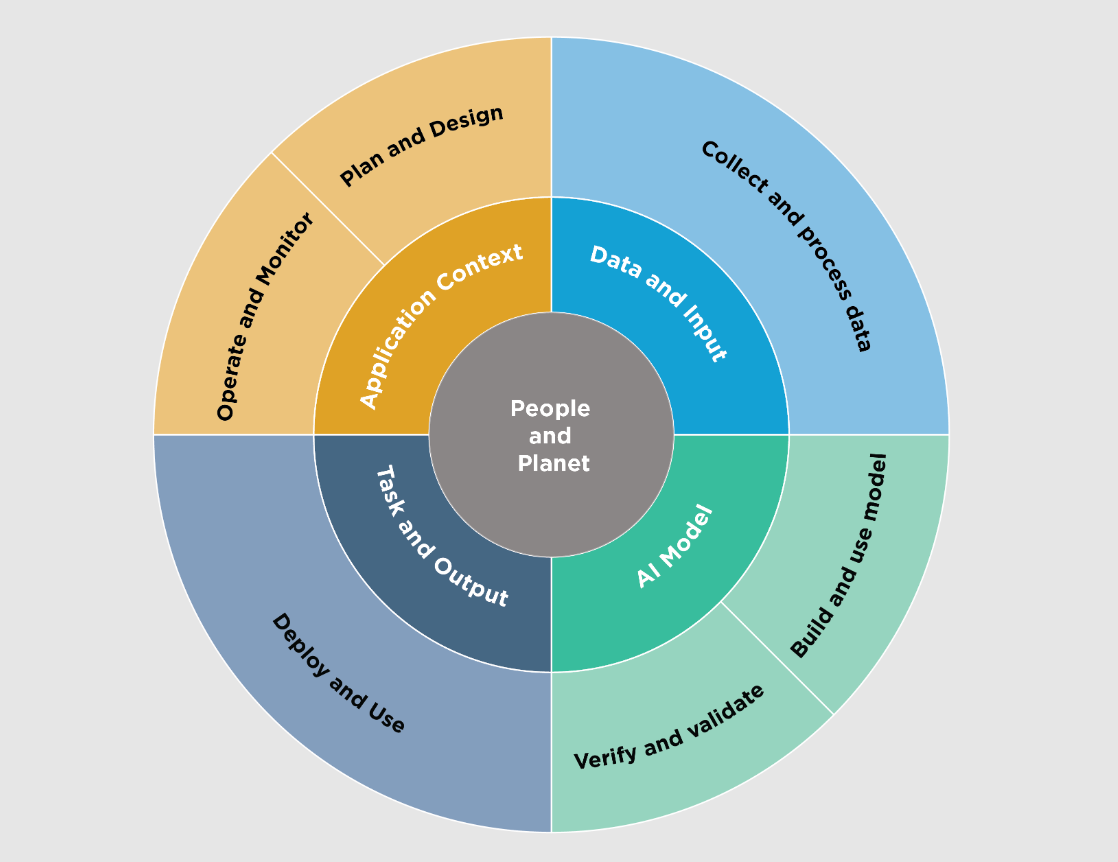

识别和管理人工智能风险和潜在影响需要在人工智能生命周期中有一套广泛的视角和参与者。受众部分描述了人工智能参与者和人工智能生命周期。

人工智能风险与可信度

为了让人工智能系统值得信赖,它们通常需要对对对相关方有价值的多种标准做出反应。提高人工智能可信度的方法可以降低人工智能的负面风险。人工智能风险和可信度部分阐述了值得信赖的人工智能的特点,并为解决这些问题提供了指导。

AI RMF的有效性

“效果”一节介绍了该框架用户的预期收益。

AI RMF核心

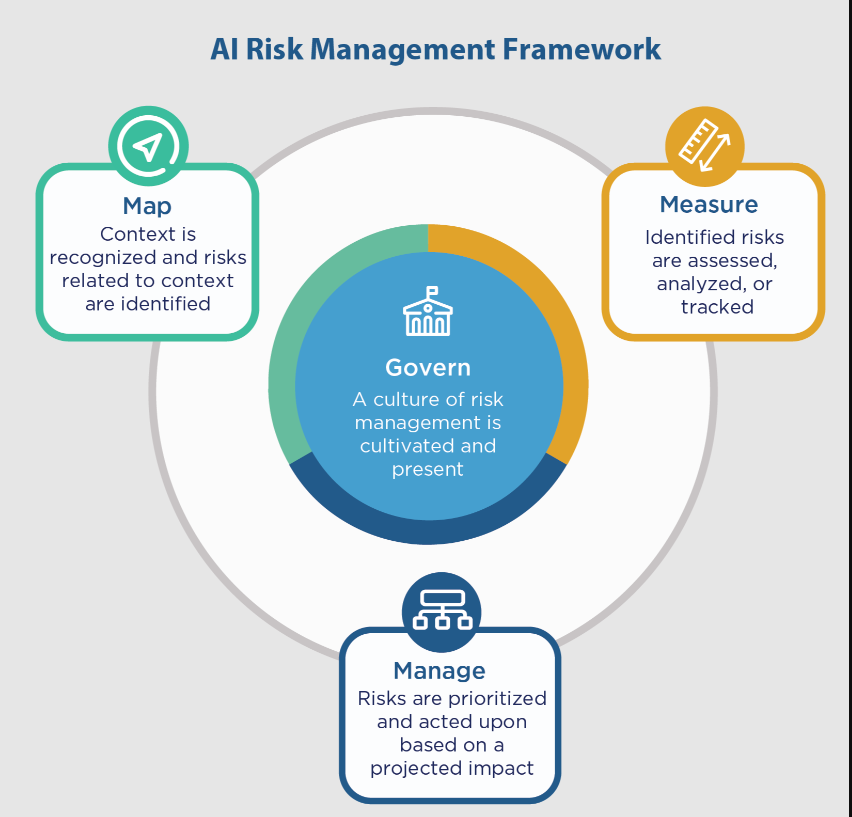

人工智能RMF核心提供的结果和行动能够实现对话、理解和活动,以管理人工智能风险和责任,开发值得信赖的人工智能系统。这是通过四个功能来操作的:管理、映射、测量和管理。

AI RMF画象文件

用例简介是基于框架用户的需求、风险承受能力和资源,针对特定设置或应用程序的AI RMF功能、类别和子类别的实现。

- Appendix A: Descriptions of AI Actor Tasks

- Appendix B: How AI Risks Differ from Traditional Software Risks

- Appendix C: AI Risk Management and Human-AI Interaction

- Appendix D: Attributes of the AI RMF

发布日期

星期三, 二月 7, 2024 - 15:15

最后修改

星期三, 二月 7, 2024 - 17:09

Article

最新内容

- 2 weeks 5 days ago

- 4 months 2 weeks ago

- 4 months 2 weeks ago

- 4 months 2 weeks ago

- 4 months 2 weeks ago

- 4 months 2 weeks ago

- 4 months 2 weeks ago

- 4 months 2 weeks ago

- 4 months 2 weeks ago

- 4 months 2 weeks ago