category

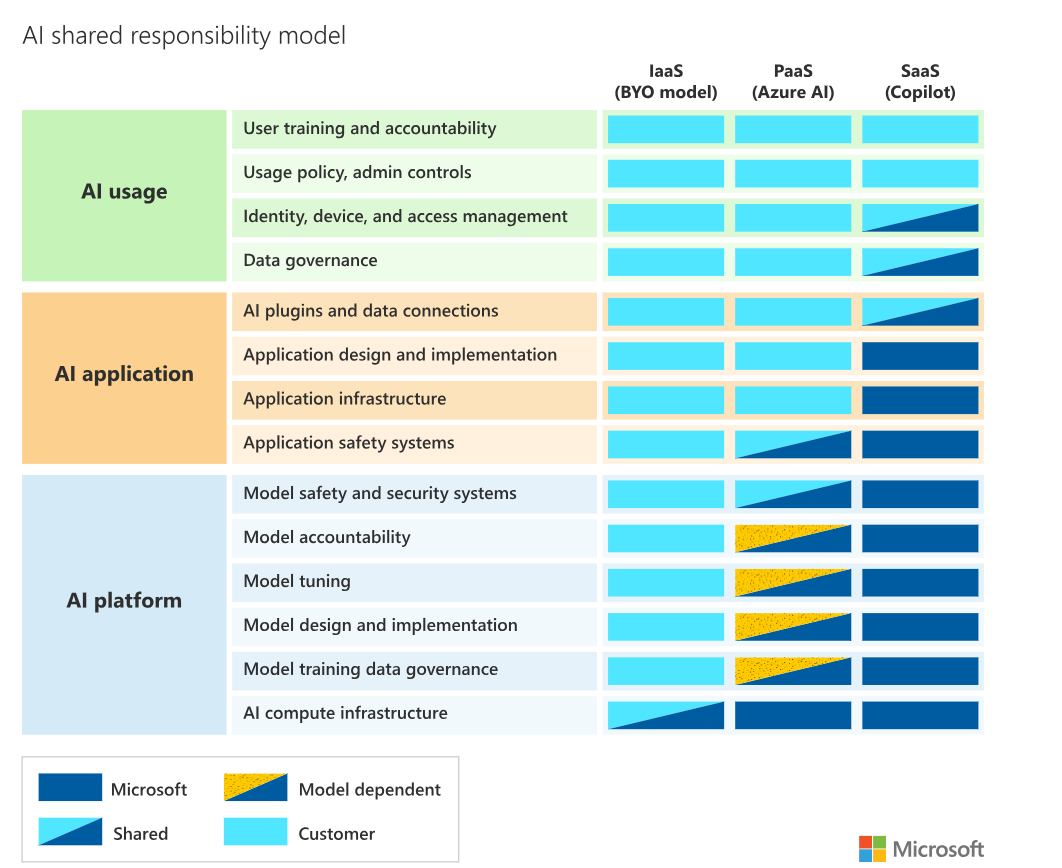

在考虑和评估人工智能集成时,了解共享责任模型、人工智能平台或应用程序提供商处理哪些任务以及您处理哪些任务至关重要。工作负载责任因AI集成是基于软件即服务(SaaS)、平台即服务(PaaS)还是基础设施即服务(IaaS)而异。

责任划分

与云服务一样,在为组织实施人工智能功能时,您也有选择。根据您选择的选项,您将负责安全使用AI所需的必要操作和策略的不同部分。

下图根据部署类型说明了您和Microsoft之间的责任范围。

显示AI责任区的图表。

AI层概述

支持人工智能的应用程序由三层功能组成,将您或人工智能提供商执行的任务组合在一起。安全责任通常由执行任务的人承担,但人工智能提供商可能会选择将安全或其他控制作为配置选项向您公开。这三层包括:

AI平台

AI平台层为应用程序提供AI功能。在平台层,需要构建和保护运行人工智能模型的基础设施、训练数据以及改变模型行为的特定配置,如权重和偏差。该层通过API提供对功能的访问,API将称为Metaprompt的文本传递给AI模型进行处理,然后返回生成的结果,称为Prompt Response。

人工智能平台安全考虑因素-为了保护人工智能平台免受恶意输入,必须构建一个安全系统来过滤发送到人工智能模型(输入)的潜在有害指令。由于人工智能模型是生成性的,因此也有可能生成一些有害内容并将其返回给用户(输出)。任何安全系统都必须首先防止许多类别的潜在有害输入和输出,包括仇恨、越狱等。这些分类可能会根据模型知识、地区和行业随着时间的推移而演变。

微软为PaaS和SaaS产品提供了内置的安全系统:

- PaaS - Azure OpenAI Service

- SaaS - Microsoft Security Copilot

人工智能应用

AI应用程序访问AI功能,并提供用户使用的服务或界面。该层中的组件可以从相对简单到高度复杂,具体取决于应用程序。最简单的独立人工智能应用程序充当一组API的接口,这些API接收基于文本的用户提示,并将该数据传递给模型以获得响应。更复杂的人工智能应用程序包括用额外的上下文来支撑用户提示的能力,包括持久层、语义索引,或通过插件来允许访问更多的数据源。先进的人工智能应用程序也可能与现有的应用程序和系统进行交互。现有的应用程序和系统可以跨文本、音频和图像工作,以生成各种类型的内容。

人工智能应用程序安全考虑因素-必须构建应用程序安全系统,以保护人工智能应用程式免受恶意活动的侵害。安全系统对发送到AI模型的Metaprompt中使用的内容进行深入检查。安全系统还检查与任何插件、数据连接器和其他AI应用程序(称为AI Orchestration)的交互。将其整合到基于IaaS/PaaS的AI应用程序中的一种方法是使用Azure AI内容安全服务。根据您的需求,还可以使用其他功能。

AI使用

AI使用层描述了AI功能最终是如何使用和消费的。生成型人工智能提供了一种新型的用户/计算机界面,它与其他计算机界面(如API、命令输出和图形用户界面(GUI))有着根本的不同。生成式人工智能界面是交互式和动态的,允许计算机功能根据用户及其意图进行调整。生成式人工智能界面与以前的界面形成鲜明对比,以前的界面主要迫使用户学习系统设计和功能并对其进行调整。这种交互性允许用户输入而不是应用程序设计师对系统的输出产生高度影响,使安全护栏对保护人员、数据和业务资产至关重要。

人工智能使用安全考虑因素-保护人工智能使用与任何计算机系统类似,因为它依赖于身份和访问控制、设备保护和监控、数据保护和治理、管理控制和其他控制的安全保证。

由于用户对系统输出的影响越来越大,因此需要更加重视用户行为和问责制。更新可接受的使用策略并教育用户标准It应用程序与AI应用程序的差异至关重要。这些应该包括与安全、隐私和道德相关的人工智能特定考虑因素。此外,用户应该接受基于人工智能的攻击教育,这些攻击可以用来用令人信服的虚假文本、声音、视频等欺骗他们。

AI特定攻击类型定义如下:

- Microsoft Security Response Center's (MSRC) vulnerability severity classification for AI systems

- MITRE Adversarial Threat Landscape for Artificial-Intelligence Systems (ATLAS)

- OWASP top 10 for Large Language Model (LLM) applications

- OWASP Machine Learning (ML) security top 10

- NIST AI risk management framework

安全生命周期

与其他类型功能的安全性一样,规划一个完整的方法至关重要。一个完整的方法包括整个安全生命周期中的人员、流程和技术:识别、保护、检测、响应、恢复和管理。这个生命周期中的任何差距或弱点都可能让你:

- 未能保护重要资产

- 经历容易预防的攻击

- 无法处理攻击

- 无法快速恢复关键业务服务

- 不一致地应用控制

要了解更多关于人工智能威胁测试的独特性质,请阅读微软人工智能红队如何构建更安全的人工智能的未来。

自定义前配置

微软建议组织从基于SaaS的方法开始,如Copilot模型,用于最初采用人工智能和所有后续的人工智能工作负载。这最大限度地减少了您的组织为设计、操作和保护这些高度复杂的功能而必须提供的责任和专业知识。

如果当前的“现成”功能不能满足工作负载的特定需求,您可以通过使用人工智能服务(如Azure OpenAI Service)采用PaaS模型来满足这些特定需求。

定制模型构建只应由在数据科学以及人工智能的安全、隐私和道德考虑方面具有深厚专业知识的组织采用。

为了帮助将人工智能带入世界,微软正在为每种主要的生产力解决方案开发Copilot解决方案:从Bing和Windows到GitHub和Office 365。微软正在为所有类型的生产力场景开发全栈解决方案。这些都是作为SaaS解决方案提供的。内置于产品的用户界面中,它们经过调整,可以帮助用户完成特定任务,从而提高生产力。

微软确保每个Copilot解决方案都是按照我们强有力的人工智能治理原则设计的。

下一步

在Microsoft responsible AI Standard中了解有关Microsoft对负责任AI的产品开发要求的更多信息。

Learn about shared responsibilities for cloud computing.

- 登录 发表评论

- 119 次浏览

最新内容

- 2 weeks 5 days ago

- 4 months 2 weeks ago

- 4 months 2 weeks ago

- 4 months 2 weeks ago

- 4 months 2 weeks ago

- 4 months 2 weeks ago

- 4 months 2 weeks ago

- 4 months 2 weeks ago

- 4 months 2 weeks ago

- 4 months 2 weeks ago