【人工智能合规】NIST值得信赖和负责任的人工智能:受众

视频号

微信公众号

知识星球

识别和管理人工智能风险和潜在影响——包括积极影响和消极影响——需要在人工智能生命周期中有一套广泛的视角和参与者。理想情况下,人工智能参与者将代表不同的经验、专业知识和背景,并包括人口统计学和学科上不同的团队。人工智能RMF旨在供人工智能参与者在整个人工智能生命周期和维度中使用。

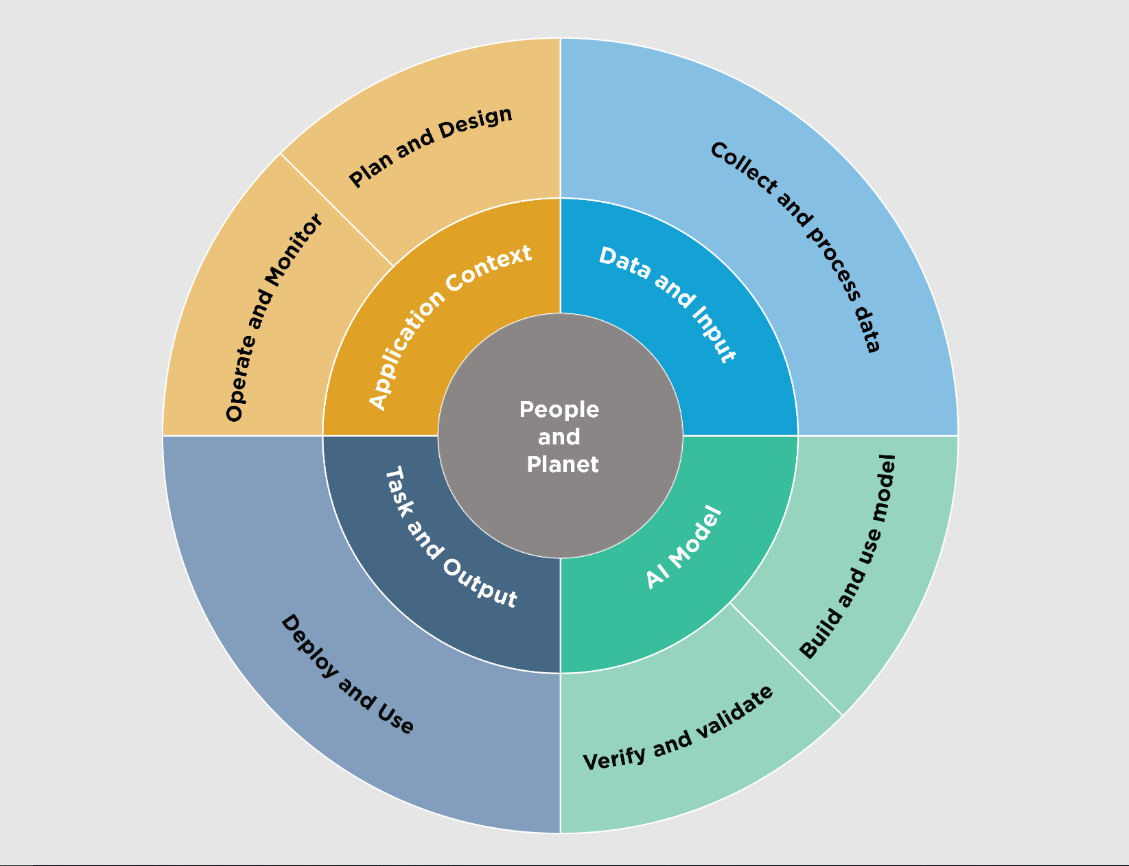

经合组织制定了一个框架,根据五个关键的社会技术维度对人工智能生命周期活动进行分类,每个维度都具有与人工智能政策和治理相关的属性,包括风险管理【经合组织(2022)经合组织人工智能系统分类框架|经合组织数字经济论文】。图2显示了这些维度,NIST对此框架进行了轻微修改。NIST的修改强调了测试、评估、验证和确认(TEVV)过程在整个人工智能生命周期中的重要性,并概括了人工智能系统的操作环境。

人工智能系统的生命周期和关键维度。

图2:人工智能系统的生命周期和关键维度。修改自经合组织(2022)《经合组织人工智能系统分类框架》|经合组织数字经济论文。两个内圈显示人工智能系统的关键维度,外圈显示人工智能生命周期阶段。理想情况下,风险管理工作从应用程序环境中的计划和设计功能开始,并在整个人工智能系统生命周期中执行。具有代表性的人工智能参与者见图3。

人工智能参与者

图3:人工智能生命周期各阶段的人工智能参与者。有关人工智能参与者任务的详细描述,包括测试、评估、验证和验证任务的详细信息,请参见附录A。请注意,人工智能模型维度(图2)中的人工智能参与者作为最佳实践是分开的,构建和使用模型的参与者与验证和验证模型的参与者是分开的。

图2中显示的AI维度是应用程序上下文、数据和输入、AI模型以及任务和输出。参与这些维度的人工智能参与者是人工智能RMF的主要受众,他们执行或管理人工智能系统的设计、开发、部署、评估和使用,并推动人工智能风险管理工作。

图3列出了整个生命周期维度的代表性人工智能参与者,并在附录A中进行了详细描述。在人工智能RMF中,所有人工智能参与者共同努力管理风险,实现值得信赖和负责任的人工智能的目标。具有TEVV特定专业知识的人工智能参与者在整个人工智能生命周期中都是集成的,特别有可能从该框架中受益。定期执行,TEVV任务可以提供与技术、社会、法律和道德标准或规范相关的见解,并有助于预测影响、评估和跟踪紧急风险。作为人工智能生命周期内的常规流程,TEVV允许进行中期补救和事后风险管理。

图2中心的人与地球维度代表了人权以及社会和地球的更广泛福祉。这个维度中的人工智能参与者包括一个单独的人工智能RMF受众,该受众向主要受众提供信息。这些人工智能参与者可能包括行业协会、标准制定组织、研究人员、倡导团体、环境团体、民间社会组织、最终用户以及可能受到影响的个人和社区。这些参与者可以:

- 协助提供背景,了解潜在和实际影响;

- 成为人工智能风险管理的正式或准正式规范和指导的来源;

- 指定人工智能操作的界限(技术、社会、法律和道德);和

- 促进讨论平衡与公民自由和权利、公平、环境和地球以及经济相关的社会价值观和优先事项所需的权衡。

成功的风险管理取决于人工智能参与者的集体责任感,如图3所示。第5节中描述的AI RMF功能需要不同的视角、学科、专业和经验。多样化的团队有助于更公开地分享关于技术目的和功能的想法和假设,使这些隐含的方面更加明确。这种更广泛的集体视角为揭示问题和识别现有和紧急风险创造了机会。

- 22 次浏览