【GAI】DevOps和IT的生成人工智能用例

视频号

微信公众号

知识星球

生成型人工智能通常与创造性项目有关,但如果组织考虑到其风险和局限性,它在DevOps和it工作流中有很好的用例。

随着成熟的算法和技术利用巨大的计算能力和无尽的原始数据海洋,人工智能领域最近爆发了。也许最有趣的发展是生成人工智能模型的出现,它以前所未有的方式合成数据以产生新的内容。

尽管生成人工智能引起了作家和艺术家的关注,但它在it和DevOps工作流中也有令人兴奋的应用。但是,尽管生成人工智能在软件开发和IT运营中有潜在的用途,但对于希望采用生成人工智能的组织来说,也有一些缺点需要考虑。

什么是生成人工智能,它是如何工作的?

在生成人工智能兴起之前,许多人工智能系统旨在进行数据分析和数据驱动决策,如预测分析和商业预测。生成型人工智能模型更进一步,根据用户查询的训练数据生成文本、视频、代码和图像等新内容。

生成型人工智能使用被称为神经网络的复杂机器学习结构来识别训练数据中的模式和结构,然后应用该学习来创建其输出。例如,一个基于毕加索每幅已知画作的图像训练的生成性人工智能系统可以生成一幅毕加索风格的新图片。

人工智能模型是处理和分析摄入数据的实际算法。然后,软件应用程序可以使用人工智能模型来产生响应用户请求的输出。例如,OpenAI的ChatGPT聊天机器人依赖于一种称为GPT的模型。

生成对抗性网络与变压器

生成对抗性网络(GANs)是生成人工智能中最常见的神经网络框架。GANs有两个组件模型:生成器和鉴别器。

生成器根据训练数据的特征、模式和结构创建新的数据,然后由鉴别器进行评估。这个过程可以是自动的,使用奖励系统,当生成器的输出足够好,可以通过真实的东西时,自动强化生成器的行为,也可以是手动的,使用人类用户的反馈或评级来告诉人工智能其输出是否合适和正确。

实际上,鉴别器向生成器提供反馈,帮助生成器在未来创建更好的输出——这一过程被称为调优。正是这种争论或对抗行为赋予了生成人工智能随着时间的推移“学习”的明显能力。

除了GANs,生成人工智能还可以使用转换器:处理数据序列而不是单个数据点的程序或算法。因为transformer可以有效地将用户的自然语言请求转换为可操作的基于计算机的命令,所以它们通常用于处理文本。

IT运营中的生成人工智能用例

尽管ChatGPT和Dall-E等应用在娱乐、金融、医疗保健和制造业等领域受到了关注,但生成人工智能在IT运营方面也取得了进展。

- 过程自动化。生成型人工智能可以了解典型流程或工作流程的要求,并自动化许多重复的业务任务,如合规保证和数据完整性。在某些情况下,生成人工智能甚至可以用最少的人工干预来解决这些问题。

- 风险评估和管理。与其他类型的人工智能一样,生成型人工智能可以分析并发现从整个IT基础设施收集的大量数据中的模式,然后使用这些数据来识别安全漏洞和即将发生的系统故障等风险。预测人工智能专注于报告,而生成人工智能系统可以建议甚至实施此类问题的解决方案。

- 基础设施优化。生成型人工智能可以被教导观察基础设施的正常运行,并确定系统和网络配置的潜在改进,例如发现由于长时间的系统延迟而导致的瓶颈。人工智能系统可以解决问题,提供补救建议,并自动实施更改。

- 报告和接口。生成型人工智能可以根据数据合成文本并制定描述,使其成为it报告平台的自然补充。使用文本或语音提示,IT管理员可以对生成的人工智能系统进行有针对性的自然语言查询。例如,管理员可以要求人工智能工具执行任务,并在组织的变更管理系统中进行所需的更新,而不是手动定位和更改系统配置设置。

DevOps中的生成人工智能用例

ChatGPT等生成型人工智能平台以其生成文本(包括软件代码)的能力而闻名。因此,生成人工智能有望在DevOps生命周期的各个阶段发挥越来越大的作用。

- 代码生成。根据代码示例训练的生成型人工智能可以学习大量的编程技术,帮助团队开发软件。人工智能辅助软件开发可以包括从简单的代码完成(如建议如何完成一行或一块代码)到根据用户的详细请求创建整个例程或程序的任务。

- 测试生成。生成型人工智能擅长合成数据和生成文本,因此作为软件测试的一部分,它是创建数据和测试用例的自然选择。此外,人工智能系统可以执行这些测试并报告测试结果。生成人工智能工具甚至可以识别缺陷,并根据测试结果提供纠正和优化代码的建议。

- 错误修复。生成型人工智能模型可以分析人工和人工智能创建的代码中的错误,并提出修复方案。这可以通过减少错误和确保遵守组织的编码标准来提高软件质量。

- 自动化部署。如果代码通过测试,DevOps团队可以使用生成人工智能自动部署代码,作为工作流或流程自动化的一部分。生成型人工智能工具还可以优化工作负载的放置,并连接用于工作负载监控和KPI数据收集的仪器。

生成人工智能在DevOps和IT中的缺陷

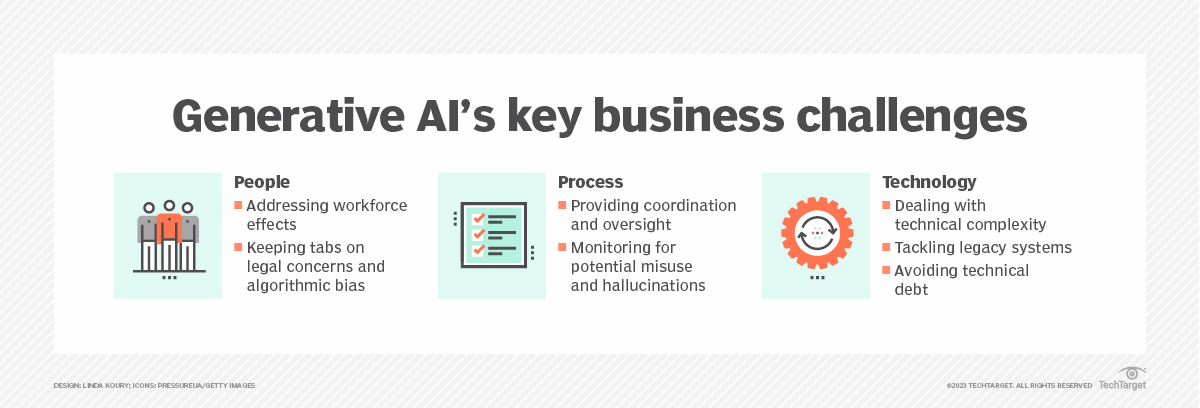

尽管有其潜力和前景,但生成人工智能目前在IT和DevOps方面存在显著的局限性,这可能会给许多组织的采用带来障碍。

重要的时间和财务投资

生成人工智能模型需要大量的训练数据。对于企业采用生成型人工智能,这可能需要在初始模型训练阶段以及正在进行的(通常是监督的)再培训和改进中对数据进行重大投资。

例如,旨在帮助运行IT基础设施的人工智能系统需要对基础设施及其配置有全面的了解。这包括系统在正常运行时的外观,以及对潜在问题的完全理解和应对措施。同样,旨在帮助企业创建代码的人工智能系统需要对组织为类似目的编写和验证的代码有全面的了解。

人工智能系统知识有限

无论人工智能在训练过程中收到多少输入,系统最终只知道它被教了什么。模型需要时间来吸收变化,而动态的IT环境可能移动得太快,人工智能无法及时响应配置变化或意外情况。

对于IT操作工作流,这意味着人工智能系统需要访问组织IT环境的准确历史和当前数据。同样,在软件开发和部署方面,一个有用的人工智能模型需要关于最新、经过良好测试的编码过程和工作流程的数据。

人工智能输出准确性的不确定性

生成型人工智能系统无法根据上下文评估其训练数据的质量或响应的正确性。这可能会引发与绩效、安全和道德相关的问题,需要人为干预。

例如,如果问题消失,应对组织IT基础设施中问题的人工智能工具可能会确定其响应是正确的,但系统的响应虽然正常,但可能不符合监管要求。同样,人工智能生成的代码并不总是高效、可互操作,甚至不能达到预期目的。

侵犯版权的可能性

特别是对于在海量数据集上训练的生成性人工智能模型,很难或不可能判断模型输出在多大程度上是基于受版权保护或其他受保护的知识产权。因此,考虑采用生成人工智能的组织面临法律问题和相关成本。

如果用户要求人工智能图像生成器(如Midtravel或Stable Diffusion)生成山景,那么一定数量的输出可能基于用于训练人工智能的受版权保护的图像。即使这被认为可以用于内部或概念验证,商业销售人工智能生成的图像也可能会带来许可问题。

对于代码创建来说,这也是一个类似的问题。如果人工智能代码生成器接受了大量开源和商业代码的培训,那么使用其输出可能会带来许可限制和其他法律问题——这是公司现在才开始考虑的问题。目前尚不清楚使用代码训练人工智能模型需要什么样的许可,因为知道代码稍后可以通知模型输出。

- 128 次浏览